Конспект урока русского языка п теме «Разбор слов по составу» 2 класс УМК «Планета Знаний»

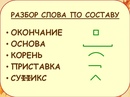

разбор слов по составу.

Закрепление по теме

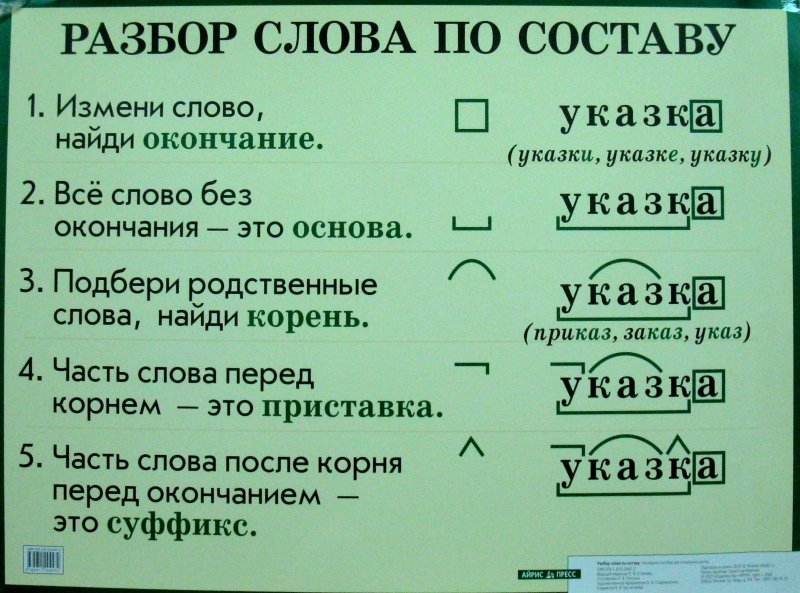

Цели деятельности учителя: учить выполнять разбор слова по составу; совершенствовать умение работать с памятками по устному и графическому разбору слов, отвечать на вопросы по теме.

Планируемые результаты: личностные: осуществляют самоконтроль при выполнении письменных заданий; метапредметные: регулятивные – научатся следовать рекомендациям памяток при анализе и списывании текстов; получат возможность научиться намечать действия при работе в паре; познавательные – научатся выполнять разбор слова по составу, осуществлять поиск необходимой информации для выполнения учебных заданий, используя справочные материалы учебника; коммуникативные – научатся договариваться и приходить к общему решению, работая в паре; получат возможность научиться задавать вопросы, уточняя непонятное в тексте;

Ход урока

Организационный момент..

− Сегодня будем учиться выполнять анализ (разбор) слова по составу.

Актуализация знаний.

Слово делится на части,

Ах, какое это счастье!

Может каждый грамотней

Сделать слово из частей.

Мы познакомились со всеми частями слова. Итак, внимание!

Какие части слова вы знаете?

-Давайте вспомним, что же такое корень? Что вы о нём знаете?

— А если к слову «корень» подставить «ОК» , стало «корешок».

— Что же такое –ок-?

— Что же такое суффикс?

— Что вы знаете о приставке?

• Игра с приставками.

− Я буду называть вам только приставки, а вы попробуете догадаться, что с ними нужно делать, к какому слову «подключить», ой, нет! – приставить. Представьте себе, что вы сидите перед телевизором. Я вам говорю: «В-!» Что вы сделаете? (Включим телевизор.)

− А если я скажу пере-? (Переключим на другую программу.)

− Теперь представьте, что мы с вами сидим на стульях на некотором расстоянии друг от друга.

− Что вы сделаете, если я скажу подо-? (Пододвинемся к Вам вместе со стульями.)

− А если я скажу ото-? (Тогда отодвинемся.)

− Что заметили, играя в эту игру? (Каждая приставка имеет своё значение.) Именно благодаря этому мы прекрасно понимаем друг друга.

− Составьте слова из рассыпанных частей слов.

По-, нес-, вы-, пере-, шёл.

От-, по-, за-, ехал.

На-, под-, над-, писал.

− Запишите полученные слова. Выделите приставки.

− Что происходит со словом после того, как меняется приставка? (Образуется новое слово с другим значением.)

— Какая часть слова называется изменяемой?

Добавьте окончания к словам, выделите окончания.

Мороз, запах, холод, поход, добр, молод, нёс, вёз.

III. Работа по учебнику.

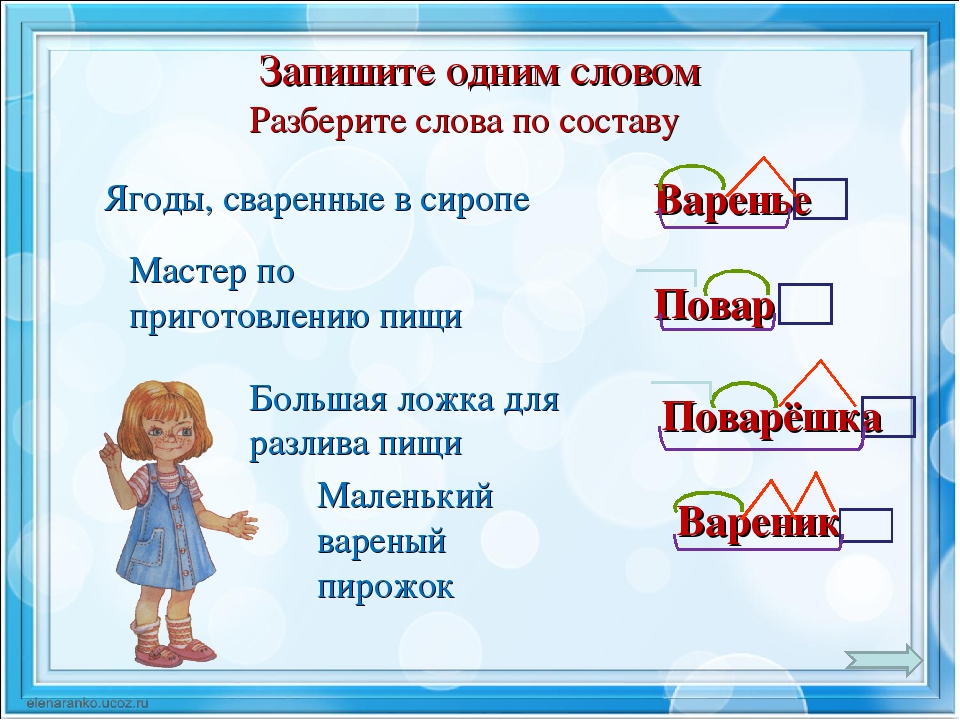

− Выполните графический анализ слова по составу в упражнении 1. (детёныши (начинает летать).)

− Прочитайте, как можно устно рассказать о составе слова «подводный».

− Прочитайте слова в упражнении 2. В какой строке даны однокоренные слова, а в какой – формы одного и того же слова? (Школа, (у) школы, (к) школе, (в) школу, школой – это формы одного и того же слова.

Школа, пришкольный (участок), школьная (пора) − однокоренные слова.)

− Выпишите слова по схемам.

− Какое слово задумано в упражнении 3? (Подкормка.)

− Запишите слово-отгадку, разделяя его для переноса. Обозначьте значимые части слова.

При переносе старайтесь не отрывать букву от корня.

− Загадайте своё слово таким же образом, как в упражнении 3.

− Приставка – как в слове «подберёзовик».

Суффикс – как в слове «цветник».

Окончание – как в слове «конь».

Слово-отгадка:

− Какие слова в упражнении 5 вызывают улыбку?

− Разберите письменно по составу выделенные слова.

IV. Рефлексия деятельности.

− Что нового узнали на уроке? Назовите части слова.

− Без какой значимой части слово не существует? (Без корня.)

− Какие части слова помогают образовывать однокоренные слова? (Суффикс, приставка.)

Домашнее задание: упражнение 6 (рабочая тетрадь)

Определение, фонетический (звуко-буквенный) разбор и разбор слова по составу

На данной странице представлено лексическое значение слова «пень», а также сделан звуко-буквенный разбор и разбор слова по составу с транскрипцией и ударениями.Оглавление:

- Значение слова

- Звуко-буквенный разбор

- Разбор по составу

Значение слова

ПЕНЬ, пня, м.

1. Нижняя часть ствола срубленного, спиленного или сломленного дерева вместе с оставшимися в земле корнями и комлем. Корчевать пни. Пни на вырубке. Как п. стоит кто-н. (неподвижно, бессмысленно; разг. неодобр.). Молчит, как п. кто-н. (ничего не говорит; разг. неодобр.).

Корчевать пни. Пни на вырубке. Как п. стоит кто-н. (неподвижно, бессмысленно; разг. неодобр.). Молчит, как п. кто-н. (ничего не говорит; разг. неодобр.).

2. перен. Тупой бесчувственный человек (разг. пренебр.). Разве этот п. может что-н. понять?

• Через пень колоду (разг. неодобр.) кое-как, небрежно, плохо.

В лесу живёт, пню молится кто (разг. ирон.) о тёмном, невежественном человеке.

| уменьш.

| прил. пенёчный, ая, ое (к 1 знач.) и пнёвый, ая, ое (к 1 знач.).

Фонетический (звуко-буквенный) разбор

Пе́нь

Пень — слово из 1 слога: Пень. Ударение ставится однозначно на единственную гласную в слове.

Транскрипция слова: [п’эн’]

п — [п’] — согласный, глухой парный, мягкий (парный)

е — [э] — гласный, ударный

н — [н’] — согласный, звонкий непарный, сонорный (всегда звонкий), мягкий (парный)

ь — не обозначает звука

В слове 4 буквы и 3 звука.

Цветовая схема: пень

Разбор слова «пень» по составу

пень

Части слова «пень»: пень

Состав слова:

пень — корень,

нулевое окончание,

пень — основа слова.

разбор слова по составу и словообразовательный разбор выход, опилки, вырасти, наконечник,

Найти все обособления в тексте и обозначить их

Акимов, опытный охотник, пробирался по кустарнику. Берег снова вздымался вверх, и начиналось редколесь

… е: ель, сосна, береза.

Увидев внизу землянку, Акимов направился к ней. Окруженная слева и справа желтыми зарослями осоки, она приютилась у берега, возле самой воды.

Он раскрыл дверь, и на него пахнуло копченой рыбой, нежным ароматом скошенного сена.

синквейн на слова венера

спишите расставляя недостающие знаки препинания вставляя пропущенные буквы укажите условия обособления приложений-

1. Составьте из группы предложений текст. Определите смысловые отношении между ними и расставьте их в нужной последовательности. Как вы будете искать … первое предложение?

1.С какими частями речи(с существительными и с прилагательными) можно соотнести перечисленные местоимения? никакой ,ничто, что-нибудь ,мой, тот, его(с … обака), она. 2.Устно определи разряды местоимений и в каждой строке найди лишнее слово. а) никто(не явился), некого(обвинять), нечего ( делать), некто(в шапочке). б)твой (учебник), себя (не узнал), свой (человек), мой (бегемот). в) кое-кто (напакостил), нечто (ужасное), ничто (не помешает), кто-нибудь (поможет). г) такой (вот случай), каждый (пятиклассник), любой (крокодил), (приготовил) сам.

помогите пожалуйста соедини слова в пары Составь и запиши с ними предложения Добавь второстепенные члены небо туча дождь капельки забарабанили начал … ся надвинулась потемнело подчеркни грамматическую основу предложения

выпишите раскрывая скобки вставляя пропущенные буквы в которых выделенные слова являются предлогами 1. я находилась у дедушки (в) продолжени..всего ле

… та 2. читатели заинтересованы (в) продолжени…рассказа 3. обнаружились важные детали (в) следстви…об аварии 4.(Не)смотря на трудности, поход завершился удачно

я даю 25 баллов

обнаружились важные детали (в) следстви…об аварии 4.(Не)смотря на трудности, поход завершился удачно

я даю 25 баллов

текста. Какие слова, по-вашему, если основную смысловую нагрузку?354. Прочитайте. Какова основная мысль текста? Озаглавьте его. Определите стильУ кажд … ого времени года своя музыка.Снег померк. Весёлой струйкой с…ребряные шарики торопливо скаты-вают…ся с крыш. Мелодично поёт, звонко Тикает к…пель. Тихо пер…звани-ваются б…ющиеся сосульки и вдребезги разбивают…ся, точно оброненныйхрусталь. А в кустах слышит…ся частый звон серебр…ного колокольчика. Этозаливают…СЯ Овсянки.Солнечный луч всюду з…водит тихую музыку весны, а птицы и водапо…певают ей.По Д. Зуеву• Спишите текст, вставьте пропущенные буквы.Найдите в тексте 1) простое нераспространённое предложение, 2) сложноесоюзное предложение. Укажите в них основы.

Умение играть на инструменте помогает вам ценить музыку? ЭССЕ

Выпишите словосочетания и найдите главное слово. Весною мы пошли в лес. Взошло солнце. Подул лёгкий ветерок. Все деревья в лесу запели. У каждого дере … ва была своя песня. Нежно пела берёза. Свою мужественную песню пел дуб. Задумчиво напевала верба. Кудрявая рябина пела тревожно. Её песня навевала мысли о бурной грозе в тёмную ночь.

Репетитор по русскому

Сочинение ЕГЭ 2016 по русскому языку — это задание повышенной сложности, поэтому необходимо очень внимательно отнестись к его выполнению, а значит, и к подготовке.

В данной статье я попытаюсь подробно разобрать план сочинения и особенности его написания. Независимо от содержания текста, лучше всего пользоваться следующим планом, составленным на основе критериев оценивания:

1) Формулировка проблемы

2) Комментарий к проблеме

3) Позиция автора по выбранной проблеме

4) Собственное мнение (согласие или несогласие)

5) Доказательство своего мнения (включая не менее 2-х аргументов)

Для гармоничности изложения и композиционной целостности желательно включить в свою работу вступление и заключение (но это не обязательно).

К1. Формулировка проблемы

Проблема текста — это предмет обсуждения, вопрос, над которым рассуждает автор.

Как правило, исходный текст включает не менее 2-3 тем, каждая из которых может стать основой вашей работы. Выбор должен определяться ответом на два вопроса:

1) Какая проблема находится в центре внимания автора?

2) К какой проблеме вам легче подобрать аргументы?

Как определить проблему?

При выявлении проблемы текста можно использовать следующий способ:

- Сформулируйте основную мысль автора в виде законченного предложения.

- Подумайте, на какой вопрос отвечает это предложение.

Разберем на примере:

Прочитав текст несколько раз я выделяю две проблемы:

1) проблема духовного существования человека в современном мире

2) проблема снижения интереса к чтению в XXI веке

Я выбираю вторую. На основе собственного впечатления от прочитанного текста я составил вступление, а проблему сформулировал в виде вопроса:

Вспоминаю, как в детстве просил родителей прочитать сказку. Они читали. Я вырос, давно уже читаю сам, как «бумажные» книги, так и электронные. Но все чаще вижу нарастающее равнодушие к чтению и литературе в целом.

Неужели книга перестала играть в жизни общества и человека привычную для нее роль? Над этой проблемой размышляет И. Косолапов.

В качестве вступления можно было привести статистику:

Согласно официальной статистике Всероссийского центра изучения общественного мнения, треть россиян не хранит дома книг, другая треть, имея книги, их не читает.

К2. Комментарий к проблеме

Комментарий — это пояснение, толкование выбранной проблемы. Комментарий помогает более детально охарактеризовать проблему, а также, показать как автор подходит к её раскрытию. При написании сочинения комментарий служит связующим звеном между проблемой и позицией автора. Главное требование к комментарию — опора на текст.

При написании сочинения комментарий служит связующим звеном между проблемой и позицией автора. Главное требование к комментарию — опора на текст.

Следующие вопросы могут послужить основой для комментария к проблеме:

Как автор относится к предмету описания?

Какие аргументы приводит автор?

На каких примерах автор раскрывает проблему? Какими событиями иллюстрирует её?

Как относится автор к предмету описания (герою)?

Насколько проблема волнует автора?

В чем сущность данной проблемы?

Какова актуальность проблемы? Насколько она значима?

Использует ли автор противопоставление? Если да, то что противопоставляет?

Комментируем нашу проблему:

Рассуждая о судьбе книги в XXI веке, автор противопоставляет книгу и достижения технического прогресса. При этом автор сталкивает мнения разных поколений: Л.Леонова, который назвал книгу «бескорыстным верным другом», и молодого программиста, определившего книгу как «кипу пыльной бумаги». И. Косолапов рассуждает о преимуществах и недостатках техники перед книгой, и находит вторую более предпочтительной и полезной.

К3. Авторская позиция

Авторская позиция — это ответ на вопрос обозначенный в проблеме.

Авторская позиция является итогом размышления, выводом к которому автор приходит (в рамках выбранной проблемы). Авторская позиция может выражаться прямо (в отдельных предложениях, обращениях к читателю) либо косвенно (в поступках героев, художественных деталях).

Автор убеждает нас в том, что книга нисколько не потеряла своей ценности, а технические достижения не смогут и не должны заменить её. Книга несет очень важную образовательную функцию, она учит и воспитывает человека. Техника и компьютеры призваны облегчать нашу повседневность, делать её более комфортной, но они не должны занимать собой всю нашу жизнь.

К4. Аргументация экзаменуемым собственного мнения по проблеме

В первую очередь нам необходимо выразить своё мнение, соглашаясь или не соглашаясь с мнением автора.

Моё мнение:

Я полностью разделяю мнение И.Косолапова о том, что книга в наше время незаслуженно забыта, хотя значение её по-прежнему велико. Я думаю, что в наш информационный век постоянное использование компьютеров и разнообразных гаджетов приведет к деградации общества, вырождению человеческой мысли.

Структура аргумента

Для получения максимального количества баллов нам необходимо привести не менее 2-х аргументов (один из которых опирается на художественную, научную, публицистическую литературу). Приведенный пример должен выступать как яркий микротекст и доказывать нашу позицию.

Моя аргументация:

1. К подобным неутешительным выводам приходили и фантасты ХХ века (логический переход). Один из которых, Рей Брэдбери, в своей антиутопии «451 градус по Фаренгейту» описывает потребительское общество, опирающееся на массовую культуру. В этом социуме люди окружили себя материальными ценностями, телевидением и развлечениями. Книги, в свою очередь, строго запрещены и подлежат сожжению, дабы ни одна критическая мысль не попала в человеческое сознание (аргумент). Когда я вижу, как люди тратят свое время на телевидение и социальные сети, я понимаю, о чем предупреждал нас Р.Брэдбери. Важная задача стоит перед нами, с помощью книг сохранить связь с интеллектуальным наследием человечества (микровывод).

2. Насколько высока может быть роль книг в духовном становлении личности мы можем узнать в произведениях М.Горького: «Детство», «В людях», «Мои университеты». Герой повестей Алеша Пешков считает, что именно книги помогли ему преодолеть тяжелые жизненные испытания.

Как видите, я привожу два примера из художественной литературы. В качестве аргумента также можно использовать: ссылки на кинофильм, спектакль, исторические события, официальную статистику, высказывания известных людей и примеры из личного опыта.

Аргументируя свою позицию, я использую «аргумент к угрозе»(доказывая негативные последствия игнорирования тезиса привожу антиутопию Р.Брэдбери) и «аргумент к обещанию» (на примере Пешкова показываю как важны книги).

Заключение

Заключение должно подводить итог нашим размышлениям по проблеме.

В своем заключении я сначала использую обращение, а потом обобщаю проблему, указываю на её глобальную важность.

Хочется обратиться к современникам: друзья, погружаться в художественные миры гораздо интереснее и полезнее, чем блуждать в интернет-паутине! Помните, что культура развивается в первую очередь за счет сохранения мудрости предыдущих поколений, хранящейся в книгах.

Надеюсь материал был Вам полезен.

5 класс. Русский язык. Способы словообразования — Состав слова.

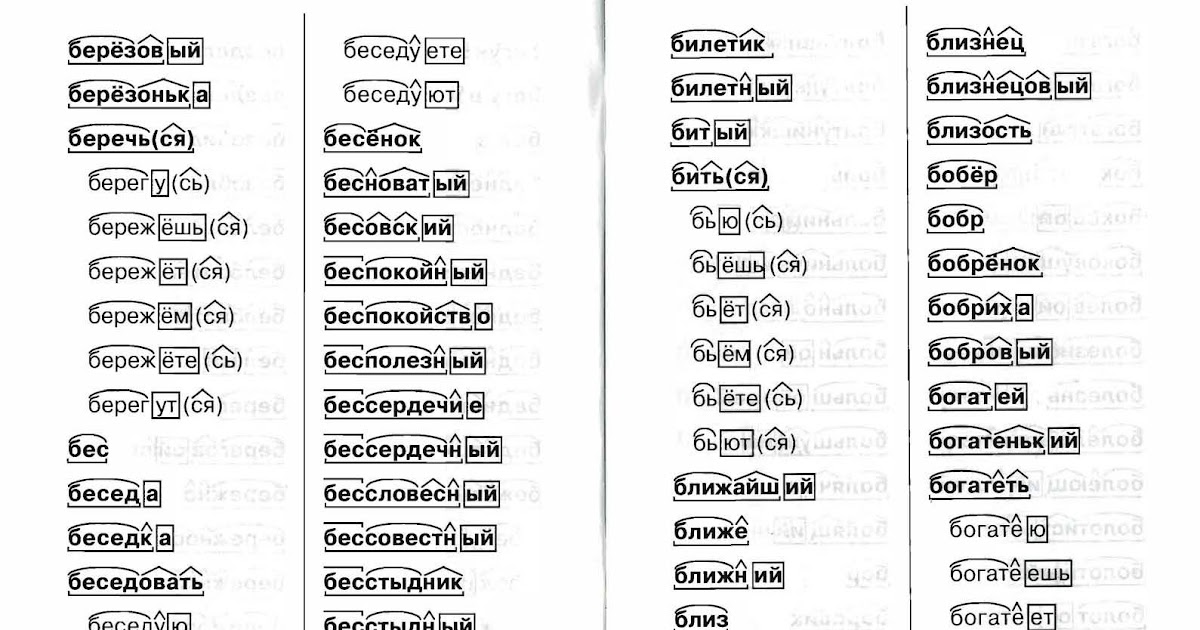

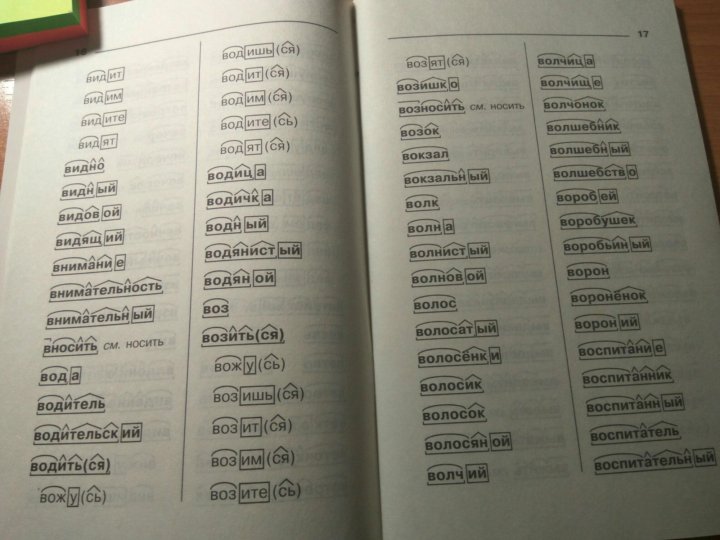

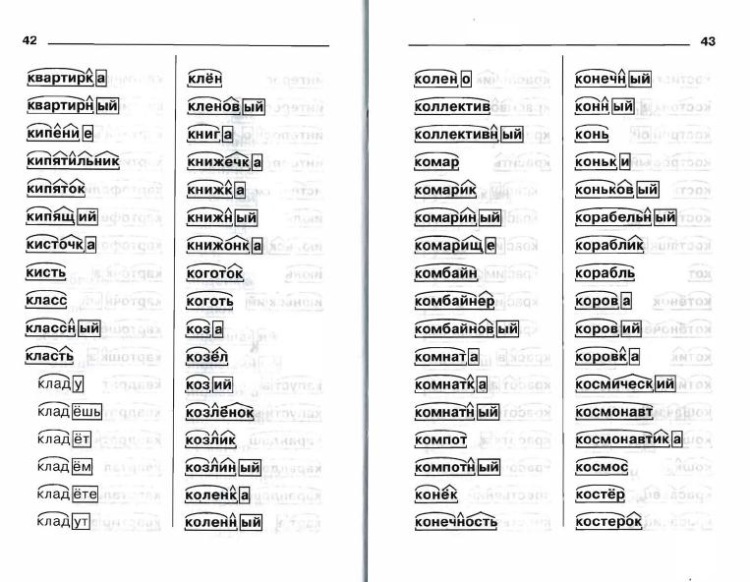

Комментарии преподавателя1. Морфемика – это раздел языкознания, в котором изучается система морфем языка и морфемная структура слов.

Морфема – это минимальная значимая часть слова.

Морфемы: корень, суффикс, приставка, окончание.

Рис. 1. Морфемы.

2.Корень – это обязательная часть слова.

Только из корня состоят служебные слова (но, для, если), междометия (ах, алло), многие наречия (очень, весьма), неизменяемые существительные (алоэ, кенгуру) и прилагательные (беж, макси).

Корни, которые могут употребляться только в сочетании с приставками или суффиксами, называются связанными (об-у-ть, раз-у-ть; о-де-ть, раз-де-ть).

3.Приставка — словообразовательная морфема, стоящая перед корнем или другой приставкой (пере-делать, пре-хорошенький, при-морье, кое-где, пере—о-деть).

Рис.2. Приставка.

4.Суффикс — словообразовательная морфема, стоящая после корня (стол-ик, красн-е-ть).

Рис. 3. Суффикс.

В лингвистике наряду с суффиксом выделяют также постфикс — словообразовательную морфему, стоящую после окончания или формообразующего суффикса (умы-ть-ся, к-ого-либо).

5.Окончание — формообразующая морфема, выражающая грамматические значения рода, лица, числа и падежа (хотя бы одно из них!) и служащая для связи слов в словосочетании и предложении,

Окончание есть только у изменяемых слов. Нет окончаний у служебных слов, наречий, неизменяемых существительных и прилагательных, деепричастий, инфинитива.

У некоторых сложных существительных и числительных несколько окончаний.

Сравните: тр-и-ст-а, тр-ех-сот-□, диван□-кровать□, диван-а-кроват-и.

Нулевая морфема – это значимое отсутствие морфемы.

Стола – Р.п.

Стол□ – И.п. или В.п.

Нулевой суффикс мы выделяем, например, в форме прошедшего времени нёс (сравните: нес-л-а) или форме повелительного наклонения читай.

План морфемного разбора слова:

1. Выделяем окончание и основу слова.

2. Выделяем корень слова, подбирая однокоренные слова.

3. Выделяем приставки и суффиксы.

Образец морфемного разбора:

Двухэтажный (окончания –ух, -ый, основа … (такая основа называется прерывистой), корни дв-, этаж-, суффикс –н-).

Переулок (окончание нулевое, основа переулок, корень –ул-, приставка пере-, суффикс –ок).

Словообразование – это процесс образования производных слов и раздел языкознания, изучающий этот процесс.

Способы словообразования:

Приставочный: делать – переделать

Суффиксальный: синий – синенький

Приставочно-суффиксальный: стакан – подстаканник

Усечение: заместитель – зам

Сложение: лес+степь – лесостепь

Сращение: вечнозеленый

Аббревиация: Московский государственный университет – МГУ, сберегательный банк – сбербанк

Субстантивация (переход прилагательного или причастия в существительное): столовая

Смешанные способы словообразования: орден+носить = орденоносец (сложение и суффиксация)

План словообразовательного разбора слова:

1. Поставить слово в начальную форму.

2. Определить слово, от которого оно образовано. Например, обновление – обновить (а не новый).

3. Объяснить значение исследуемого слова через значение слова, от которого оно образовано (например, слушатель – тот, кто слушает).

4. Выделить основу, от которой образовано исследуемое слово.

5. Указать средство словообразования.

6. Указать способ словообразования.

Образец словообразовательного разбора:

1. Под-окон-ник – окно

Основа окн-

Средства словообразования: приставка под- и суффикс –ник. Способ словообразования: приставочно-суффиксальный

2. Мир(о)твор-ец – мир+творить

Основы, от которых образовано слово, — мир- и твор-

Средства словообразования: сложение основ и суффикс –ец.

Способ словообразования: сложение и суффиксация

10. Домашнее задание

Домашнее задание

Упражнения №

Задание №1. Даны слова: петь, учить, одеть, знал, столик, верхом, рано, волчонок, новее, ворча. Для каких слов из перечисленных годится следующий морфемный разбор:?

Задание №2. Даны слова: обучить, приходила, узнали, подоконник, треугольник, встряска, настольный, излишне, снова. Для каких слов из перечисленных годится следующий морфемный разбор:

ИСТОЧНИКИ

http://www.youtube.com/watch?v=AeX6EALboR8

http://doc4web.ru/russkiy-yazik/konspekt-uroka-dlya-klassa-sostav-slova-i-slovoobrazovanie.html

http://nsportal.ru/shkola/russkiy-yazyk/library/2014/10/28/konspekt-uroka-sostav-slova-5-klass

http://nsportal.ru/shkola/russkiy-yazyk/library/2012/12/01/konspekt-uroka-russkogo-yazyka-v-5-klasse-po-temezakreplenie

| 1 | «В начале было Слово…» | история | история | 2 |

| литература | литература | 3 | ||

| 2 | «Наследники Левши» | физика | физика | 3 |

| 3 | XIII Южно-Российская межрегиональная олимпиада школьников «Архитектура и искусство» по комплексу предметов (рисунок, живопись, композиция, черчение) | искусство, черчение | рисунок, живопись, композиция, черчение | 2 |

| 4 | Всероссийская олимпиада по финансовой грамотности, финансовому рынку и защите прав потребителей финансовых услуг | финансовая грамотность | экономика | 3 |

| 5 | Всероссийская олимпиада учащихся музыкальных колледжей | хоровое дирижирование | дирижирование (дирижирование академическим хором) | 2 |

| инструменты народного оркестра | искусство концертного исполнительства (концертные народные инструменты) | 2 | ||

| струнные инструменты | искусство концертного исполнительства (концертные струнные инструменты) | 3 | ||

| теория и история музыки | музыковедение, музыкознание и музыкально-прикладное искусство (музыкальная журналистика и редакторская деятельность в средствах массовой информации) | 2 | ||

| музыкальная педагогика и исполнительство | музыкознание и музыкально-прикладное искусство (музыкальная педагогика) | 3 | ||

| 6 | Всероссийская олимпиада школьников «Высшая проба» | биология | биология | 2 |

| востоковедение | востоковедение и африканистика | 2 | ||

| дизайн | дизайн | 1 | ||

| журналистика | журналистика | 1 | ||

| иностранный язык | иностранный язык | 1 | ||

| восточные языки | иностранный язык | 2 | ||

| электроника и вычислительная техника | инфокоммуникационные технологии и системы связи, информатика и вычислительная техника | 2 | ||

| информатика | информатика | 1 | ||

| история | история | 1 | ||

| история мировых цивилизаций | история | 2 | ||

| культурология | культурология | 1 | ||

| математика | математика | 1 | ||

| основы бизнеса | менеджмент, государственное и муниципальное управление | 3 | ||

| обществознание | обществознание | 1 | ||

| политология | политология, обществознание | 1 | ||

| право | право | 1 | ||

| психология | психология | 2 | ||

| русский язык | русский язык | 1 | ||

| социология | социология, обществознание | 1 | ||

| физика | физика | 3 | ||

| филология | филология, литература | 1 | ||

| философия | философия, обществознание | 1 | ||

| химия | химия | 2 | ||

| экономика | экономика | 1 | ||

| финансовая грамотность | экономика | 2 | ||

| 7 | Всероссийская олимпиада школьников «Миссия выполнима. Твое призвание-финансист!» Твое призвание-финансист!» | история | история | 3 |

| математика | математика | 3 | ||

| обществознание | обществознание | 3 | ||

| экономика | экономика | 3 | ||

| 8 | Всероссийская олимпиада школьников «Нанотехнологии — прорыв в будущее!» | нанотехнологии | химия, физика, математика, биология | 1 |

| 9 | Всероссийская Сеченовская олимпиада школьников | биология | биология | 3 |

| 10 | Всероссийская Толстовская олимпиада школьников | история | история | 2 |

| обществознание | обществознание | 3 | ||

| литература | педобразование профиль «русский язык и литература», филология профиль «отечественная филология» | 3 | ||

| 11 | Всероссийская экономическая олимпиада школьников имени Н.Д. Кондратьева | экономика | экономика | 1 |

| 12 | Всероссийский конкурс научных работ школьников «Юниор» | инженерные науки | естественные науки, инженерные науки, приборостроение, ядерная энергетика и технологии, физико-технические науки и технологии, технологии материалов, нанотехнологии и наноматериалы, мехатроника и робототехника | 3 |

| естественные науки | естественные науки, промышленная экология и биотехнологии, экология и природопользование | 2 | ||

| 13 | Всесибирская открытая олимпиада школьников | астрономия | астрономия | 3 |

| биология | биология | 2 | ||

| информатика | информатика | 1 | ||

| математика | математика | 2 | ||

| физика | физика | 2 | ||

| химия | химия | 1 | ||

| 14 | Вузовско-академическая олимпиада по программированию на Урале | программирование | информатика | 3 |

| 15 | Герценовская олимпиада школьников | география | география | 2 |

| иностранные языки | иностранные языки | 2 | ||

| 16 | Городская открытая олимпиада школьников по физике | физика | физика | 2 |

| 17 | Государственный аудит | обществознание | обществознание | 2 |

| 18 | Инженерная олимпиада школьников | физика | физика | 2 |

| 19 | Интернет-олимпиада школьников по физике | физика | физика | 2 |

| 20 | Кутафинская олимпиада школьников по праву | право | право | 2 |

| 21 | Межвузовская олимпиада школьников «Первый успех» | педагогические науки и образование | педагогическое образование, психолого-педагогическое образование, педагогическое образование (с двумя профилями подготовки), специальное (дефектологическое) образование | 2 |

| 22 | Междисциплинарная олимпиада школьников имени В. И. Вернадского И. Вернадского | гуманитарные и социальные науки | история, обществознание | 1 |

| 23 | Международная олимпиада школьников «Искусство графики» | рисунок | графика, дизайн | 2 |

| графический дизайн | дизайн | 2 | ||

| 24 | Межрегиональная олимпиада по праву «ФЕМИДА» | право | обществознание | 2 |

| 25 | Межрегиональная олимпиада школьников «САММАТ» | математика | 01.03.00 математика и механика, 02.03.00 компьютерные и информационные науки, 09.03.00 информатика и вычислительная техника, 10.03.00 информационная безопасность | 3 |

| 26 | Межрегиональная олимпиада школьников «Архитектура и искусство» по комплексу предметов (рисунок, композиция) | искусство | рисунок, композиция | 2 |

| 27 | Межрегиональная олимпиада школьников «Будущие исследователи — будущее науки» | биология | биология | 2 |

| история | история | 2 | ||

| математика | математика | 3 | ||

| русский язык | русский язык | 2 | ||

| физика | физика | 3 | ||

| химия | химия | 2 | ||

| 28 | Межрегиональная олимпиада школьников «Евразийская лингвистическая олимпиада» | иностранный язык | иностранный язык | 2 |

| 29 | Межрегиональная олимпиада школьников им. В.Е.Татлина | рисунок | искусство | 2 |

| композиция | искусство | 2 | ||

| графика | искусство | 2 | ||

| 30 | Межрегиональная олимпиада школьников им. И.Я. Верченко И.Я. Верченко | компьютерная безопасность | информационная безопасность | 3 |

| математика | математика, криптография | 2 | ||

| 31 | Межрегиональная олимпиада школьников на базе ведомственных образовательных организаций | иностранный язык | иностранный язык | 3 |

| математика | математика | 2 | ||

| обществознание | обществознание | 3 | ||

| физика | физика | 3 | ||

| 32 | Межрегиональная отраслевая олимпиада школьников «Паруса надежды» | математика | математика | 3 |

| техника и технологии | техника и технологии строительства, информационная безопасность, электро- и теплоэнергетика, машиностроение, техносферная безопасность и природообустройство, техника и технологии наземного транспорта, управление в технических системах, экономика и управление, сервис и туризм | 3 | ||

| 33 | Межрегиональные предметные олимпиады федерального государственного автономного образовательного учреждения высшего образования «Казанский (Приволжский) федеральный университет» | иностранный язык | иностранный язык | 2 |

| физика | физика | 3 | ||

| химия | химия | 2 | ||

| 34 | Межрегиональный экономический фестиваль школьников «Сибириада. Шаг в мечту» | экономика | экономика, обществознание | 2 |

| 35 | Многопредметная олимпиада «Юные таланты» | география | география | 1 |

| геология | геология | 3 | ||

| химия | химия | 1 | ||

| 36 | Многопрофильная инженерная олимпиада «Звезда» | естественные науки | компьютерные и информационные науки, биологические науки, архитектура, техника и технологии строительства, информатика и вычислительная техника, информационная безопасность, электроника, радиотехника и системы связи, фотоника, приборостроение, оптические и биотехнические системы и технологии, электро- и теплоэнергетика, ядерная энергетика и технологии, машиностроение, оружие и системы вооружения, химические технологии, промышленная экология и биотехнологии, техносферная безопасность и природообустройство, прикладная геология, горное дело, нефтегазовое дело и геодезия, технологии материалов, техника и технологии наземного транспорта, авиационная и ракетно-космическая техника, аэронавигация и эксплуатация авиационной и ракетно-космической техники, техника и технологии кораблестроения и водного транспорта, управление в технических системах, нанотехнологии и наноматериалы, технологии легкой промышленности, сельское, лесное и рыбное хозяйство, экономика и управление | 3 |

| техника и технологии | технологии материалов, машиностроение, электроэнергетика, авиационная и ракетно-космическая техника, техника и технологии наземного транспорта, техника и технологии кораблестроения и водного транспорта | 2 | ||

| 37 | Многопрофильная олимпиада школьников Уральского федерального университета «Изумруд» | история | история | 3 |

| математика | математика | 3 | ||

| обществознание | обществознание | 3 | ||

| политология | обществознание | 3 | ||

| социология | обществознание | 3 | ||

| русский язык | русский язык | 3 | ||

| физика | физика | 3 | ||

| 38 | Московская олимпиада школьников | астрономия | астрономия | 1 |

| генетика | биология, математика | 3 | ||

| география | география | 1 | ||

| информатика | информатика | 1 | ||

| история искусств | искусство | 1 | ||

| изобразительное искусство | искусство | 2 | ||

| история | история | 2 | ||

| математика | математика | 1 | ||

| робототехника | математика, информатика | 3 | ||

| обществознание | обществознание | 2 | ||

| право | право | 2 | ||

| лингвистика | русский язык, иностранный язык | 1 | ||

| филология | русский язык, литература, филология | 2 | ||

| физика | физика | 1 | ||

| предпрофессиональная | физика, информатика, химия | 3 | ||

| химия | химия | 1 | ||

| экономика | экономика | 2 | ||

| финансовая грамотность | экономика | 3 | ||

| 39 | Общероссийская олимпиада школьников «Основы православной культуры» | основы православной культуры | теология, история | 2 |

| 40 | Объединённая межвузовская математическая олимпиада школьников | математика | математика | 2 |

| 41 | Объединённая международная математическая олимпиада «Формула Единства» / «Третье тысячелетие» | математика | математика | 2 |

| физика | физика | 3 | ||

| 42 | Океан знаний | история | история | 3 |

| обществознание | обществознание | 3 | ||

| русский язык | русский язык | 3 | ||

| 43 | Олимпиада Кружкового движения Национальной технологической инициативы | программная инженерия финансовых технологий | информатика и вычислительная техника, информационная безопасность, компьютерные и информационные науки | 3 |

| умный город | информатика и вычислительная техника, информационная безопасность, электроника, радиотехника и системы связи, фотоника, приборостроение, оптические и биотехнические системы и технологии, электро — и теплоэнергетика, электроника и автоматика физических установок, техносферная безопасность и природообустройство, технологии материалов, управление в технических системах, компьютерные и информационные науки | 3 | ||

| большие данные и машинное обучение | информатика и вычислительная техника, компьютерные и информационные науки | 2 | ||

| аэрокосмические системы | информатика и вычислительная техника, электроника, радиотехника и системы связи, прикладная математика и информатика, мехатроника и робототехника, управление в технических системах | 3 | ||

| интеллектуальные робототехнические системы | информатика и вычислительная техника, электроника, радиотехника и системы связи, управление в технических системах, компьютерные и информационные науки | 1 | ||

| беспилотные авиационные системы | информатика и вычислительная техника, электроника, радиотехника и системы связи, фотоника, приборостроение, оптические и биотехнические системы и технологии, авиационная и ракетно-космическая техника, аэронавигация и эксплуатация авиационной и ракетно-космической техники, управление в технических системах | 2 | ||

| технологии беспроводной связи | компьютерные и информационные науки, информатика и вычислительная техника, информационная безопасность, электроника, радиотехника и системы связи, управление в технических системах | 2 | ||

| интеллектуальные энергетические системы | компьютерные и информационные науки, информатика и вычислительная техника, информационная безопасность, электроника, радиотехника и системы связи, электро — и теплоэнергетика, управление в технических системах | 3 | ||

| искусственный интеллект | математика и механика, компьютерные и информационные науки, информатика и вычислительная техника, информационная безопасность | 3 | ||

| информационная безопасность | математика и механика, компьютерные и информационные науки, информатика и вычислительная техника, информационная безопасность, электроника, радиотехника и системы связи | 3 | ||

| автоматизация бизнес-процессов | математика и механика, компьютерные и информационные науки, информатика и вычислительная техника, информационная безопасность, электроника, радиотехника и системы связи, автоматизация технологических процессов и производств, управление в технических системах, экономика и управление | 2 | ||

| композитные технологии | машиностроение, нанотехнологии и наноматериалы, материаловедение и технологии материалов, ракетные комплексы и космонавтика, наноинженерия | 3 | ||

| инженерные биологические системы: агробиотехнологии | науки о земле, биологические науки, фотоника, приборостроение, оптические и биотехнические системы и технологии, электро- и теплоэнергетика, машиностроение, химические технологии, промышленная экология и биотехнологии, техносферная безопасность и природообустройство, сельское, лесное и рыбное хозяйство | 3 | ||

| анализ космических снимков и геопространственных данных | науки о земле, информатика и вычислительная техника, природообустройство и водопользование, прикладная геология, горное дело, нефтегазовое дело и геодезия, водные пути, порты и гидротехнические сооружения, управление водным транспортом и гидрографическое обеспечение судоходства, сельское, лесное и рыбное хозяйство, экономика, государственное и муниципальное управление, бизнес-информатика, зарубежное регионоведение, регионоведение россии, востоковедение и африканистика, туризм | 3 | ||

| водные робототехнические системы | приборостроение, информатика и вычислительная техника, электроника, радиотехника и системы связи, мехатроника и робототехника, управление в технических системах, кораблестроение, океанотехника и системотехника объектов морской инфраструктуры | 2 | ||

| нейротехнологии и когнитивные науки | прикладная математика и информатика, математическое обеспечение и администрирование информационных систем, прикладная информатика, фотоника, приборостроение, оптические и биотехнические системы и технологии, управление в технических системах, психология | 2 | ||

| передовые производственные технологии | прикладная математика и информатика, механика и математическое моделирование, прикладная математика и информатика, математика и компьютерные науки, информатика и вычислительная техника, информационные системы и технологии, программная инженерия, автоматизация технологических процессов и производств, конструкторско-технологическое обеспечение машиностроительных производств, мехатроника и робототехника | 2 | ||

| спутниковые системы | физика и астрономия, информатика и вычислительная техника, электроника, радиотехника и системы связи, физико-технические науки и технологии, авиационная и ракетно-космическая техника, аэронавигация и эксплуатация авиационной и ракетно-космической техники, управление в технических системах | 3 | ||

| наносистемы и наноинженерия | физика и астрономия, химия, биологические науки, электроника, радиотехника и системы связи, фотоника, приборостроение, оптические и биотехнические системы и технологии, химические технологии, технологии материалов, нанотехнологии и наноматериалы | 2 | ||

| автономные транспортные системы | фундаментальная информатика и информационные технологии, информатика и вычислительная техника, машиностроение, системы управления движением и навигация, аэронавигация и эксплуатация авиационной и ракетно-космической техники, управление в технических системах | 3 | ||

| летающая робототехника | фундаментальная информатика и информационные технологии, информатика и вычислительная техника, электроника, радиотехника и системы связи, системы управления движением и навигация, аэронавигация и эксплуатация авиационной и ракетно-космической техники, управление в технических системах | 3 | ||

| геномное редактирование | экология и природопользование, биологические науки, химические технологии, промышленная экология и биотехнологии, техносферная безопасность и природообустройство, наноинженерия, агроинженерия, ветеринария и зоотехния | 3 | ||

| 44 | Олимпиада Курчатов | математика | математика | 2 |

| физика | физика | 2 | ||

| 45 | Олимпиада МГИМО МИД России для школьников | гуманитарные и социальные науки | история, обществознание | 2 |

| 46 | Олимпиада по комплексу предметов «Культура и искусство» | технический рисунок и декоративная композиция | декоративно-прикладное искусство и народные промыслы, технология художественной обработки материалов, искусство костюма и текстиля, конструирование изделий легкой промышленности, технологии и проектирование текстильных изделий, технология изделий легкой промышленности, информационные системы и технологии, технология полиграфического и упаковочного производства, прикладная информатика, профессиональное обучение | 1 |

| академический рисунок, живопись, композиция, история искусства и культуры | дизайн, графика, монументально-декоративное искусство, декоративно-прикладное искусство и народные промыслы, технология художественной обработки материалов, искусство костюма и текстиля, конструирование изделий легкой промышленности, технологии и проектирование текстильных изделий, технология изделий легкой промышленности, информационные системы и технологии, технология полиграфического и упаковочного производства, прикладная информатика, профессиональное обучение (по отраслям) | 1 | ||

| 47 | Олимпиада РГГУ для школьников | иностранный язык | иностранный язык | 2 |

| история | история | 2 | ||

| литература | литература | 2 | ||

| русский язык | русский язык | 2 | ||

| 48 | Олимпиада Университета Иннополис «Innopolis Open» | информатика | информатика | 2 |

| математика | математика | 3 | ||

| 49 | Олимпиада школьников «Гранит науки» | информатика | компьютерные и информационные науки, информатика и вычислительная техника, информационная безопасность, машиностроение, управление в технических системах, экономика и управление | 3 |

| естественные науки | науки о земле, электроника, радиотехника и системы связи, фотоника, приборостроение, оптические и биотехнические системы и технологии, электро- и теплоэнергетика, машиностроение, техносферная безопасность и природоустройство, прикладная геология, горное дело, нефтегазовое дело и геодезия, техника и технологии наземного транспорта | 3 | ||

| химия | химия, науки о земле, биологические науки, химические технологии, промышленная экология и биотехнологии, технологии материалов | 2 | ||

| 50 | Олимпиада школьников «Ломоносов» | биология | биология | 1 |

| география | география | 1 | ||

| геология | геология | 1 | ||

| журналистика | журналистика | 1 | ||

| иностранный язык | иностранный язык | 1 | ||

| информатика | информатика | 1 | ||

| политология | история | 2 | ||

| международные отношения и глобалистика | история | 1 | ||

| история | история | 1 | ||

| история российской государственности | история | 1 | ||

| литература | литература | 1 | ||

| математика | математика | 1 | ||

| философия | обществознание | 1 | ||

| обществознание | обществознание | 1 | ||

| экология | почвоведение, экология и природопользование | 2 | ||

| психология | психология | 1 | ||

| русский язык | русский язык | 1 | ||

| физика | физика | 2 | ||

| инженерные науки | фундаментальная и прикладная химия, прикладные математика и физика | 3 | ||

| космонавтика | фундаментальная математика и механика | 2 | ||

| механика и математическое моделирование | фундаментальные математика и механика | 3 | ||

| робототехника | фундаментальные математика и механика, мехатроника и робототехника, фундаментальная информатика и информационные технологии | 3 | ||

| химия | химия | 1 | ||

| право | юриспруденция | 1 | ||

| 51 | Олимпиада школьников «Надежда энергетики» | информатика | информатика | 3 |

| физика | физика | 3 | ||

| комплекс предметов (физика, информатика, математика) | физика, информатика, математика | 3 | ||

| 52 | Олимпиада школьников «Покори Воробьёвы горы!» | биология | биология | 1 |

| география | география | 2 | ||

| журналистика | журналистика | 1 | ||

| иностранный язык | иностранный язык | 1 | ||

| история | история | 2 | ||

| литература | литература | 1 | ||

| математика | математика | 1 | ||

| обществознание | обществознание | 1 | ||

| физика | физика | 1 | ||

| 53 | Олимпиада школьников «Робофест» | физика | физика | 2 |

| 54 | Олимпиада школьников «Физтех» | биология | биология | 3 |

| математика | математика | 2 | ||

| физика | физика | 1 | ||

| 55 | Олимпиада школьников «Шаг в будущее» | программирование | информатика и вычислительная техника | 2 |

| математика | математика | 3 | ||

| инженерное дело | математика и механика, компьютерные и информационные науки, информатика и вычислительная техника, информационная безопасность, электроника, радиотехника и системы связи, фотоника, приборостроение, оптические и биотехнические системы и технологии, электро- и теплоэнергетика, ядерная энергетика и технологии, машиностроение, физико-технические науки и технологии, оружие и системы вооружения, техносферная безопасность и природоустройство, технологии материалов, техника и технологии наземного транспорта, авиационная и ракетно-космическая техника, управление в технических системах, нанотехнологии и наноматериалы | 2 | ||

| компьютерное моделирование и графика | математика и механика, компьютерные и информационные науки, информатика и вычислительная техника, электроника, радиотехника и системы связи, фотоника, приборостроение, оптические и биотехнические системы и технологии, электро- и теплоэнергетика, ядерная энергетика и технологии, машиностроение, физико-технические науки и технологии, оружие и системы вооружения, техносферная безопасность и природоустройство, технологии материалов, техника и технологии наземного транспорта, авиационная и ракетно-космическая техника, управление в технических системах, нанотехнологии и наноматериалы | 3 | ||

| физика | физика | 2 | ||

| 56 | Олимпиада школьников по информатике и программированию | информатика | информатика | 1 |

| 57 | Олимпиада школьников по программированию «ТехноКубок» | информатика | информатика и икт | 1 |

| 58 | Олимпиада Российской академии народного хозяйства и государственной службы при Президенте Российской Федерации | иностранный язык | английский язык | 2 |

| журналистика | журналистика | 2 | ||

| история | история | 2 | ||

| иностранный язык | китайский язык | 2 | ||

| обществознание | обществознание | 2 | ||

| политология | политология | 2 | ||

| экономика | экономика, математика | 3 | ||

| 59 | Олимпиада школьников Санкт-Петербургского государственного университета | биология | биология | 1 |

| география | география | 1 | ||

| журналистика | журналистика | 1 | ||

| китайский язык | иностранный язык | 2 | ||

| иностранный язык | иностранный язык | 1 | ||

| филология | иностранный язык, литература, русский язык | 1 | ||

| информатика | информатика | 1 | ||

| история | история | 1 | ||

| медицина | лечебное дело, стоматология, психология, клиническая психология, психология служебной деятельности | 1 | ||

| математика | математика | 1 | ||

| обществознание | обществознание | 1 | ||

| социология | обществознание, история | 1 | ||

| право | право | 1 | ||

| инженерные системы | прикладная математика и информатика, механика и математическое моделирование, прикладные математика и физика, радиофизика, системный анализ и управление, химия, физика и механика материалов | 3 | ||

| физика | физика | 2 | ||

| химия | химия | 1 | ||

| экономика | экономика | 2 | ||

| 60 | Олимпиада школьников федерального государственного бюджетного образовательного учреждения высшего образования «Всероссийский государственный университет юстиции (РПА Минюста России)» «В мир права» | история | история | 3 |

| право | обществознание, право | 3 | ||

| 61 | Олимпиада Юношеской математической школы | математика | математика | 2 |

| 62 | Открытая межвузовская олимпиада школьников Сибирского Федерального округа «Будущее Сибири» | физика | физика | 3 |

| химия | химия | 2 | ||

| 63 | Открытая олимпиада Северо-Кавказского федерального университета среди учащихся образовательных организаций «45 параллель» | география | география | 2 |

| 64 | Открытая олимпиада школьников | информатика | информатика | 1 |

| математика | математика | 3 | ||

| 65 | Открытая олимпиада школьников по программированию | информатика | информатика | 1 |

| 66 | Открытая олимпиада школьников по программированию «Когнитивные технологии» | информатика и икт | информатика | 2 |

| 67 | Открытая региональная межвузовская олимпиада вузов Томской области (ОРМО) | география | география | 3 |

| история | история | 2 | ||

| литература | литература | 2 | ||

| математика | математика | 3 | ||

| русский язык | русский язык | 3 | ||

| физика | физика | 3 | ||

| 68 | Открытая химическая олимпиада | химия | химия | 2 |

| 69 | Отраслевая олимпиада школьников «Газпром» | информационные и коммуникационные технологии | информатика | 3 |

| физика | физика | 3 | ||

| химия | химия | 3 | ||

| 70 | Отраслевая физико-математическая олимпиада школьников «Росатом» | математика | математика | 2 |

| физика | физика | 1 | ||

| 71 | Плехановская олимпиада школьников | иностранный язык | английский язык, немецкий язык | 3 |

| экономика | обществознание | 3 | ||

| финансовая грамотность | обществознание | 3 | ||

| русский язык | русский язык | 2 | ||

| 72 | Региональный конкурс школьников Челябинского университетского образовательного округа | иностранный язык | иностранный язык | 3 |

| 73 | Санкт-Петербургская олимпиада школьников | астрономия | астрономия | 1 |

| математика | математика | 1 | ||

| химия | химия | 1 | ||

| 74 | Северо-Восточная олимпиада школьников | филология | русский язык, литература | 3 |

| 75 | Сибирская межрегиональная олимпиада школьников «Архитектурно-дизайнерское творчество» | архитектура, изобразительные и прикладные виды искусств | архитектура, дизайн, дизайн архитектурной среды, градостроительство | 2 |

| 76 | Строгановская олимпиада на базе МГХПА им. С.Г. Строганова С.Г. Строганова | рисунок, живопись, скульптура, дизайн | искусство, дизайн | 1 |

| 77 | Телевизионная гуманитарная олимпиада школьников «Умницы и умники» | гуманитарные и социальные науки | журналистика, зарубежное регионоведение, международные отношения, политология, реклама и связи с общественностью | 1 |

| 78 | Турнир городов | математика | математика | 1 |

| 79 | Турнир имени М.В. Ломоносова | астрономия и науки о земле | астрономия | 3 |

| биология | биология | 2 | ||

| история | история | 2 | ||

| литература | литература | 2 | ||

| математика | математика | 2 | ||

| лингвистика | русский язык, иностранный язык, математика | 2 | ||

| физика | физика | 2 | ||

| химия | химия | 3 | ||

| 80 | Университетская олимпиада школьников «Бельчонок» | информатика | информатика | 3 |

| математика | математика | 3 | ||

| химия | химия | 3 | ||

| 81 | Учитель школы будущего | иностранный язык | востоковедение и африканистика, педагогическое образование (профиль «иностранный язык»), лингвистика, филология | 3 |

| 82 | Филологическая олимпиада для школьников 5-11 классов «Юный словесник» | филология | русский язык, литература | 2 |

| 83 | Межрегиональная открытая олимпиада по музыкально-теоретическим дисциплинам для учащихся детских музыкальных школ и детских школ искусств | теория и история музыки | сольфеджио, музыкальная литература | 3 |

(PDF) Анализ комбинаторной категориальной грамматики через планирование в программировании набора ответов

Этот расширенный инструмент вычислительной семантики, мы стремимся создать выходной формат для AS PCC GTK, совместимый с Boxer

.

Поскольку наша структура является общей структурой синтаксического анализа, мы можем легко сравнивать различные наборы правил CCG

с точки зрения их эффективности и нормализации. Мы также подозреваем, что улучшение масштабируемости

ccg.asp возможно с использованием альтернативного набора комбинаторных правил вместо того, которое в настоящее время реализовано в ccg

.жерех Повышение типа — основной источник недетерминизма в синтаксическом анализе CCG и одна из причин

ложных деревьев синтаксического анализа и длительного времени синтаксического анализа. В будущем мы хотели бы оценить подход, в котором

частично исключает повышение типа, вставляя его во все комбинаторы без повышения типа. Похожая стратегия

была предложена для комбинаторов композиции Виттенбургом [30] .16 Комбинирование правил CCG таким образом создает на

дополнительных комбинаторов, однако эти правила содержат меньше недетерминированных предположений о повышении категорий.

Уменьшенный недетерминизм должен повысить эффективность решения без потери каких-либо выводов CCG.

Благодарности. Мы хотели бы поблагодарить Джона Биверса и Владимира Лифшица за ценные подробные комментарии

к докладу семинара, в котором представлены предварительные результаты этой работы [21]. Мы особенно благодарны

Брайану Силверторну за то, что он поделился с нами экспериментальными результатами, представленными на Рисунке 3. Мы

в долгу перед Джейсоном Болдриджем, Марчелло Бальдуччини, Йоханом Босом, Эсрой Эрдем, Майклом Финком, Майклом Гельфондом,

Джухен Ли, и Мирославу Трущинскому за полезные обсуждения и комментарии, относящиеся к теме этой работы

.Юлия Лиерлер получила стипендию CRA / NSF 2010 Computing Innovation Fellowship. Peter Sch ¨

uller

был поддержан проектом ICT08-020 Венского фонда науки и технологий (WWTF).

Ссылки

1. Биверс, Дж .: Документация: реализация CCG для LKB. Tech. представитель Стэнфордского университета, Центр изучения языка и информации

Tech. представитель Стэнфордского университета, Центр изучения языка и информации

(2003)

2. Биверс, Дж., Саг, И.: Многоточие в координатах и очевидная неконструктивная координация.В: Международная конференция по грамматике

Head-Driven Phrase Structure Grammar (HPSG’04). стр. 48–69 (2004)

3. Биверс, Дж .: Комбинаторно-категориальная грамматика по типу наследования. В: Международная конференция по компьютерной лингвистике

(COLING’04) (2004)

4. Бос Дж .: Семантический анализ широкого охвата с боксером. В: Бос, Дж., Делмонте, Р. (ред.) Семантика в обработке текста.

ШАГ 2008 Материалы конференции. С. 277–286. Исследования в области вычислительной семантики, публикации колледжа

(2008)

5.Чиматти, А., Писторе, М., Траверсо, П .: Автоматизированное планирование. В: ван Хармелен, Ф., Лифшиц, В., Портер, Б. (ред.)

Справочник по представлению знаний. Elsevier (2008)

6. Кларк, С., Карран, Дж. Р.: Лог-линейные модели для анализа CCG с широким охватом. В: Конференция SIGDAT по эмпирическим методам

в обработке естественного языка (EMNLP-03) (2003)

7. Кларк, С., Карран, Дж. Р.: Анализ WSJ с использованием CCG и лог-линейных моделей. В: Материалы 42-го ежегодного собрания

Ассоциации компьютерной лингвистики (ACL’04).С. 104–111. Барселона, Испания (2004)

8. Кларк С., Курран Дж. Р.: Эффективный статистический анализ с широким охватом с помощью CCG и лог-линейных моделей. Вычислительная

Лингвистика 33 (4), 493–552 (2007)

9. Джорджевич Б., Курран Дж.Р .: Эффективный комбинаторный категориальный грамматический синтаксический анализ. В: Proceedings of the 2006 Aus-

tralasian Language Technology Workshop (ALTW). С. 3–10 (2006)

10. Даути, Д .: Повышение типа, функциональная композиция и неконституционные соединения.В: Oehrle, R.T., Bach, E.,

Wheeler, D. (eds.) Категориальные грамматики и структуры естественного языка, т. 32. С. 153–197. Дордрехт, Рейдель

32. С. 153–197. Дордрехт, Рейдель

(1988)

11. Дрешер, К., Уолш, Т .: Моделирование грамматических ограничений с помощью программирования набора ответов. В: Gallagher, J.P., Gelfond,

M. (eds.) Технические сообщения 27-й Международной конференции по логическому программированию, ICLP 2011.

vol. 11, стр. 28–39 (2011)

12. Эйснер, Дж .: Эффективный синтаксический анализ нормальной формы для комбинаторно-категориальной грамматики.В: Материалы 34-го ежегодного собрания

Ассоциации компьютерной лингвистики (ACL’96). С. 79–86 (1996)

13. Эйтер, Т., Фабер, В., Леоне, Н., Пфайфер, Г., Поллерес, А .: Подход логического программирования к планированию состояния знаний —

ning : Семантика и сложность. ACM Trans. Comput. Logic 5, 206–263 (апрель 2004 г.)

14. Гебсер, М., K¨

, ониг, А., Шауб, Т., Тиле, С., Вебер, П .: Библиотека BioASP: решения ASP для системная биология.

В: 22-я Международная конференция IEEE по инструментам с искусственным интеллектом (ICTAI’10).т. 1, pp. 383–389

(2010)

16 Виттенбург ввел новый набор комбинаторных правил, объединив комбинаторы функциональной композиции с

другими комбинаторами. Путем исключения исходных комбинаторов функциональной композиции некоторые ложные деревья синтаксического анализа больше не могут быть получены.

Обучение грамматике в контексте

На этой странице

Деконтекстуализированное обучение грамматике, направленное на идентификацию и маркировку классов слов и синтаксических структур, не способствует улучшению письма.

Скорее, учебная программа по письму, которая привлекает внимание к грамматике письма встроенным и целенаправленным образом в соответствующие моменты обучения, является более позитивным путем вперед. (Myhill, Lines and Watson, 2012, стр.30).

Взгляд на грамматику как на ресурс смысла долгое время находился в центре внимания в Австралии и реализовывался, в частности, через жанровую педагогику (см. , Например, Christie, 2002; Christie & Derewianka, 2008; Rose & Martin, 2012; Rothery, 1989, с. 1994).

, Например, Christie, 2002; Christie & Derewianka, 2008; Rose & Martin, 2012; Rothery, 1989, с. 1994).

Недостаточно рассказать об общей структуре текста.Учащимся начальной школы необходимо научить, каким образом язык открывает «репертуар безграничных возможностей» по мере того, как они составляют все более сложные тексты (Myhill, Lines and Watson, 2012, p. 30).

Это требует развития металингвистической осведомленности, то есть «грамматически обоснованных знаний о языке» (Macken-Horarik, Love & Unsworth 2011, p. 11), которые поддерживают принятие языковых решений (Myhill, Jones, & Watson, 2016).

Учащиеся EAL / D и студенты, изучающие грамматикуEAL / D, не являются «чистыми листами» и имеют, явно или неявно, определенную форму понимания грамматики на английском или своем родном языке.По мере того, как они изучают английский и продолжают совершенствовать свои родные языки, студенты EAL / D обычно хорошо понимают, как работает язык (метаязыковая осведомленность).

Грамматические особенности будут отличаться в зависимости от языка учащихся. Например, в английском множественном числе существительные обычно обозначаются буквами «s» или «es», как в «girls» и «daisies». В индонезийском языке множественное число может происходить путем удвоения существительного (buku-buku saya — мои книги), в то время как формы множественного числа не существуют в мандаринском диалекте. Таким образом, учащиеся EAL / D могут быть незнакомы с конкретной формой или могут придавать значение другим способом.

С другой стороны, изучающие EAL / D также могут четко осознавать, что существуют грамматические различия между английским и их родным языком. Они могут быть очень восприимчивы к явным инструкциям по грамматике в значимом контексте.

Все учащиеся EAL / D имеют разный опыт владения английским языком. Некоторые ученики приезжают из стран, где английский может быть официальным языком или языком обучения с 3-го класса. Некоторые родители могут вводить английский намного раньше в жизни своих детей через частные школы английского языка, репетиторство или короткие поездки в англоязычные страны. Другие учащиеся EAL / D могли прервать учебу в результате войны и политических волнений в их родных странах, но они переехали и жили в различных лагерях, где говорили на английском и других языках.

Другие учащиеся EAL / D могли прервать учебу в результате войны и политических волнений в их родных странах, но они переехали и жили в различных лагерях, где говорили на английском и других языках.

Как и при любом обучении, важно оценить предыдущие знания учащихся и определить их потребности. Учителя могут обращаться к таким текстам, как Learner English (Swan & Smith, 2001), чтобы узнать о ключевых грамматических особенностях языков, на которых говорят учащиеся в их классе.

Важность языковых знаний признана в языковой составляющей Викторианской учебной программы, английский язык, где «учащиеся развивают свои знания английского языка и того, как он работает» (VCAA).

Три подстила:

- Язык для взаимодействия

- Структура и организация текста

- Выражение и развитие идей обеспечивают дальнейшее развитие этих знаний.

Язык для социальных взаимодействий

Как язык, используемый для различных формальных и неформальных социальных взаимодействий, зависит от цели и аудитории

Оценочный язык

Как язык используется для выражения мнений и вынесения оценочных суждений о людях, местах и предметах и тексты

Цель, аудитория и структуры различных типов текстов

Как тексты служат разным целям и как структуры типов текстов различаются в зависимости от цели текста

Связность текста

Как тексты работают как единое целое благодаря языковым особенностям, которые связывать части текста вместе, такие как абзацы, связки, существительные и связанные с ними местоимения

Пунктуация

Как пунктуация выполняет различные функции в тексте.

Концепции печати и экрана. Различные условные обозначения, которые применяются к тому, как текст отображается на странице или экране

Грамматика на уровне предложений и предложений

Что такое предложение и как простые, составные и сложные предложения строятся с помощью одного предложения (простого) или путем объединения предложений с использованием различных типов союзов (составных и сложных)

Грамматика уровня слов

Различные классы слов, используемых в английском языке (существительные, глаголы и т. Д.) и функции, которые они выполняют в предложениях и когда они объединены в определенные узнаваемые группы, такие как группы фраз и существительных

Д.) и функции, которые они выполняют в предложениях и когда они объединены в определенные узнаваемые группы, такие как группы фраз и существительных

Визуальный язык

Как изображения работают в текстах для передачи значений, особенно в сочетании с другими элементами, такими как печать и звук

Принципы, лежащие в основе преподавания языка

Хамфри, Дрога и Физ (2012) представляют фундаментальные принципы мышления о языке как системе ресурсов для создания смысла, принципы, которые также определяют языковую составляющую викторианской учебной программы:

- Язык — это организован в соответствии со своими функциями.

- Язык — это богатый, многоуровневый ресурс с неограниченным потенциалом создания смысла. Текст — это язык, используемый для достижения определенной социальной цели.

- Грамматика — это система шаблонов и структур, набор ресурсов, используемых для организации слов в предложения, которые образуют значения в текстах.

- Есть много разновидностей языка. Разнообразие языков, которые мы используем в любое время, определяется контекстом, в котором они используются. (Хамфри, Дрога и Физ, 2012, стр.1)

Кроме того, учащиеся также должны знать о развитии понимания того, что такое «правильное» употребление в английском языке (например, согласование подлежащего и глагола — я иду, он идет), или о знании различных классов слов, таких как существительные, глаголы, прилагательные. Студенты также должны понимать, как язык работает на уровне текста, предложения и слова.

Macken-Horarik, Love, Sandiford и Unsworth (2017) описывают три шага для того, чтобы направить разговор о языке на разных уровнях в письменных (и устных) текстах:

- определить форму или класс слова / слов в тексте (например, «Мы составили план», если «план» — это существительное, или «Мы планируем уйти», если «план» — это глагол).

- описать, как слово или единица работает или функционирует (например, группы существительных рассказывают нам о персонажах в рассказе, кто они, как они выглядят)

- объясняют, как варианты выбора работают в тексте и почему (например, «Сильный Глаголы действия используются для одного персонажа, но менее сильные — для другого, чтобы показать, что один персонаж был более сильным лидером и на него можно было положиться.

’). (Маккен-Хорарик, Лав, Сандифорд и Ансуорт, 2017, стр.15).

’). (Маккен-Хорарик, Лав, Сандифорд и Ансуорт, 2017, стр.15).

Образцы или тексты наставников

Образцы или тексты наставников должны использоваться для иллюстрации выбора языка, который учащиеся могут использовать в своих собственных текстах. Это позволяет установить четкие связи между текстами, которые читают учащиеся, текстами, которые они составляют, и тем, как они говорят о текстах, которые они читают и сочиняют.

По мере того, как учителя работают с образцами или наставническими текстами, можно выработать общий язык для разговоров о языке или метаязыке.Установление метаязыка не только поддерживает развивающиеся знания учащихся о языке, но также позволяет учителям и учащимся проводить целенаправленное обсуждение текстов, которые они читают и пишут, используя общий понятный язык.

Выбор образцов текстов или текстов наставника должен отражать аутентичные примеры текстов, которые иллюстрируют фокус обучения. Это может включать выбор отрывка или отрывков из текста для учебных целей.

При использовании модельных или наставнических текстов учителю или ученику необязательно указывать все варианты языка или даже все варианты выбора конкретного языка, например глаголы.

Скорее, выделение избранных примеров, которые иллюстрируют направленность преподавания, — это эффективный способ привлечь внимание студентов к языку и тому, как он используется в тексте.

В повествовании это может означать просмотр того, где используются глаголы действия или действия или где используются глаголы восприятия, и что они говорят нам о персонаже и о том, что он / она думает в разных точках повествования.

Развитие лингвистического контроля

По мере того, как дети учатся в начальной школе, лингвистические изменения в их контроле над письменной речью становятся очевидными.Ключевые сдвиги в развитии, которые происходят в лингвистическом контроле письма с первых лет начальной школы до подросткового возраста, подробно описаны в работах Кристи и Деревянка (2008) и Маккен-Хорарик, Лав, Сандифорд и Ансуорт (2017).

Это исследование подчеркивает, как грамматику можно рассматривать как инструмент для понимания того, как работает текст, и как эти знания могут помочь развивающимся писателям.

Для учителей, понимание лингвистического развития в письменной форме дает им возможность «обеспечивать более эффективную обратную связь, а также помогает им избегать более поверхностных оценок, ориентированных на« правильность »(Macken-Horarik & Sandiford, 2016, p.81).

Исследования траекторий развития письма в таких областях, как структура предложений, показывают, что развитие письма может быть более тесно связано с письменной компетенцией, чем с возрастом (Myhill, 2008, стр. 284). Однако основные этапы развития обычно достигаются в пределах ориентировочного возраста.

Краткое изложение основных изменений, которые могут произойти в начальных классах школы (в соответствии с разделами языка викторианской учебной программы), можно найти здесь.

Изменения в контроле письменной речи (docx — 31.5kb) — Christie & Derewianka

Сводку основных языковых ресурсов для повествования, пересчета, аргументации, процедуры, информационного отчета, объяснения (в соответствии с подразделами викторианской учебной программы) можно получить по следующим ссылкам:

Батт, Д., Фэи, Р., Физ, S & Spinks, S. (2012). Использование функциональной грамматики: Руководство исследователя (3-е издание). Южная Ярра: Macmillan Education Australia.

Кристи, Ф. (2002). Анализ дискурса в классе.Лондон: Continuum.

Кристи Ф. и Деревянка Б. (2008). Школьный дискурс: обучение письму через годы обучения. Лондон и Нью-Йорк: Континуум.

Деревянка Б. и Джонс П. (2016). Обучение языку в контексте (2-е изд.). Южный Мельбурн, Вик: Издательство Оксфордского университета.

Хамфри, С., Дрога, Л., Физ, С. (2012). Грамматика и значение. Новый город. PETAA.

Macken-Horarik, M., Love, K., Sandiford, C. & Unsworth, L. (2017). Функциональная грамматика: переосмысление знаний о языке и имидже для школьного английского.Оксон, Великобритания: Рутледж.

Маккен-Хорарик М., Лав К. и Ансуорт Л. (2011). Грамматика «достаточно хороша» для школьного английского в 21 веке: четыре задачи в реализации потенциала. Австралийский журнал языка и грамотности, 34 (1), 9-21.

Маккен-Хорарик, М. и Сандифорд, К. (2016). Диагностика развития: грамматика для отслеживания успеваемости учащихся в сочинении повествования. Международный журнал языковых исследований, 10 (3), 61-94.

Майхилл, Д., Джонс, С.И Уотсон, А. (2016). Написание разговоров: стимулирование металингвистической дискуссии о письме. Исследования в области образования, 31 (1), 23-44.

Myhill, D., Lines, H. & Watson, A. (2012). Осмысление смысла с помощью грамматики: репертуар возможностей. Английский в Австралии, 47 (3), 29-38.

Роуз Д. и Мартин Дж. Р. (2012). Учимся писать, читать, чтобы учиться: Жанр, знания и педагогика в Сиднейской школе: Лондон: Равноденствие.

Ротери, Дж. (1989). Изучение языка.В Р. Хасан и Дж. Р. Мартин (ред.), Развитие языка: язык обучения, культура обучения (стр.199 — 256). Норвуд, Нью-Джерси: Ablex.

Ротери, Дж. (1994). Изучение грамотности в школьном английском (напишите правильные ресурсы для грамотности и обучения). Сидней: Программа для школ столичного востока для малоимущих.

LATA039.dvi

% PDF-1.4 % 1 0 объект > эндобдж 5 0 obj /Заголовок /Предмет / Автор /Режиссер / CreationDate (D: 20210321194822-00’00 ‘) / ModDate (D: 20110620174235 + 02’00 ‘) >> эндобдж 2 0 obj > эндобдж 3 0 obj > эндобдж 4 0 obj > поток

Что такое встраивание слов для текста?

Последнее обновление 7 августа 2019 г.

Вложения слов — это тип представления слов, который позволяет словам со схожим значением иметь аналогичное представление.

Они представляют собой распределенное представление текста, что, возможно, является одним из ключевых достижений в области впечатляющей производительности методов глубокого обучения при решении сложных задач обработки естественного языка.

В этом посте вы познакомитесь с подходом встраивания слов для представления текстовых данных.

Заполнив этот пост, вы будете знать:

- Что такое метод встраивания слов для представления текста и чем он отличается от других методов извлечения признаков.

- Что существует 3 основных алгоритма для обучения встраиванию слова из текстовых данных.

- Что вы можете либо обучить новое вложение, либо использовать предварительно обученное вложение для своей задачи обработки естественного языка.

Начните свой проект с моей новой книги «Глубокое обучение для обработки естественного языка», включающей пошаговых руководств и файлов исходного кода Python для всех примеров.

Приступим.

Что такое встраивание слов в текст?

Фотография Хизер, некоторые права защищены.

Обзор

Этот пост разделен на 3 части; их:

- Что такое вложения слов?

- Алгоритмы встраивания слов

- Использование вложений слов

Нужна помощь с глубоким обучением текстовых данных?

Пройдите мой бесплатный 7-дневный ускоренный курс электронной почты (с кодом).

Нажмите, чтобы зарегистрироваться, а также получите бесплатную электронную версию курса в формате PDF.

Начните БЕСПЛАТНЫЙ ускоренный курс прямо сейчас

Что такое вложения слов?

Вложение слов — это заученное представление текста, в котором слова, имеющие одинаковое значение, имеют аналогичное представление.

Именно такой подход к представлению слов и документов можно считать одним из ключевых достижений глубокого обучения в решении сложных проблем обработки естественного языка.

Одно из преимуществ использования плотных и низкоразмерных векторов — вычислительные: большинство инструментов нейронных сетей плохо работают с разреженными векторами очень высокой размерности.… Основным преимуществом плотных представлений является возможность обобщения: если мы считаем, что некоторые функции могут давать аналогичные подсказки, стоит предоставить представление, которое способно уловить эти сходства.

— стр. 92, Методы нейронных сетей в обработке естественного языка, 2017.

Вложения слов на самом деле представляют собой класс методов, при которых отдельные слова представляются как векторы с действительными значениями в заранее определенном векторном пространстве. Каждое слово сопоставляется с одним вектором, и значения вектора изучаются способом, напоминающим нейронную сеть, и, следовательно, этот метод часто относят к области глубокого обучения.

Ключом к подходу является идея использования плотного распределенного представления для каждого слова.

Каждое слово представлено вектором с действительными значениями, часто с десятками или сотнями измерений. Это контрастирует с тысячами или миллионами измерений, необходимых для разреженных представлений слов, таких как одноразовое кодирование.

связать с каждым словом в словаре вектор признаков распределенного слова… Вектор признаков представляет различные аспекты слова: каждое слово связано с точкой в векторном пространстве.Количество функций… намного меньше, чем размер словаря

— Нейро-вероятностная языковая модель, 2003.

Распределенное представление изучается на основе использования слов. Это позволяет словам, которые используются одинаково, приводить к похожим представлениям, естественным образом передавая их значение. Этому можно противопоставить четкое, но хрупкое представление в модели мешка слов, где, если явно не управлять, разные слова имеют разные представления, независимо от того, как они используются.

За этим подходом стоит более глубокая лингвистическая теория, а именно «гипотеза распределения » Зеллига Харриса, которую можно резюмировать следующим образом: слова, имеющие схожий контекст, будут иметь схожие значения. Для более подробной информации см. Статью Харриса 1956 года «Распределительная структура».

Это понятие, позволяющее употреблению слова определять его значение, можно резюмировать с помощью часто повторяемой шутки Джона Ферта:

Вы должны знать слово по компании, в которой оно находится!

— стр. 11, «Краткий обзор лингвистической теории 1930-1955 гг.», В «Исследованиях по лингвистическому анализу 1930-1955, 1962».

Алгоритмы встраивания слов

Методы встраивания слов изучают вещественное векторное представление для предопределенного словаря фиксированного размера из корпуса текста.

Процесс обучения либо объединяется с моделью нейронной сети для выполнения некоторой задачи, такой как классификация документов, либо является неконтролируемым процессом с использованием статистики документов.

В этом разделе рассматриваются три метода, которые можно использовать для изучения встраивания слова из текстовых данных.

1. Встраиваемый слой

Уровень внедрения, из-за отсутствия лучшего названия, представляет собой встраивание слов, которое изучается совместно с моделью нейронной сети для конкретной задачи обработки естественного языка, такой как языковое моделирование или классификация документов.

Требуется, чтобы текст документа был очищен и подготовлен таким образом, чтобы каждое слово было закодировано по очереди. Размер векторного пространства указывается как часть модели, например 50, 100 или 300 измерений. Векторы инициализируются небольшими случайными числами. Слой внедрения используется во внешнем интерфейсе нейронной сети и подбирается контролируемым образом с использованием алгоритма обратного распространения.

… когда входные данные нейронной сети содержат символические категориальные признаки (например, признаки, которые принимают один из k различных символов, например слова из закрытого словаря), обычно связывают каждое возможное значение признака (т.е.е., каждое слово в словаре) с d-мерным вектором для некоторого d. Эти векторы затем считаются параметрами модели и обучаются вместе с другими параметрами.

— стр. 49, Методы нейронных сетей в обработке естественного языка, 2017.

Слова с горячим кодированием отображаются в векторы слов. Если используется многослойная модель персептрона, то векторы слов объединяются перед подачей в качестве входных данных в модель. Если используется рекуррентная нейронная сеть, то каждое слово может использоваться как один вход в последовательности.

Этот подход к изучению слоя встраивания требует большого количества обучающих данных и может быть медленным, но при этом будет изучаться встраивание, ориентированное как на конкретные текстовые данные, так и на задачу НЛП.

2. Word2Vec

Word2Vec — это статистический метод для эффективного обучения автономному встраиванию слов из корпуса текста.

Разработан Томасом Миколовым и др. в Google в 2013 году в ответ на повышение эффективности обучения встраиванию на основе нейронных сетей, и с тех пор он стал де-факто стандартом для разработки предварительно обученного встраивания слов.

Кроме того, работа включала анализ выученных векторов и изучение векторной математики для представлений слов. Например, вычитание « мужественности » из « король » и добавление « женского достоинства » дает слово « королева », улавливая аналогию « король для королевы, поскольку мужчина есть женщине “.

Мы обнаружили, что эти представления на удивление хороши для улавливания синтаксических и семантических закономерностей в языке, и что каждое отношение характеризуется смещением вектора, зависящим от отношения.Это позволяет использовать векторные рассуждения на основе смещений между словами. Например, отношения мужчина / женщина изучаются автоматически, и с помощью индуцированных векторных представлений «Король — Мужчина + Женщина» дает вектор, очень близкий к «Королеве».

— Лингвистические закономерности в представлениях слов в непрерывном пространстве, 2013.

Были представлены две разные модели обучения, которые можно использовать как часть подхода word2vec для изучения встраивания слов; их:

- Непрерывный мешок слов, или модель CBOW.

- Непрерывная модель скип-грамма.

Модель CBOW изучает встраивание, предсказывая текущее слово на основе его контекста. Модель непрерывной скип-граммы учится, предсказывая окружающие слова по текущему слову.

Модель непрерывной скип-граммы обучается, предсказывая окружающие слова по текущему слову.

Обучающие модели Word2Vec

Взято из «Эффективной оценки представлений слов в векторном пространстве», 2013 г.

Обе модели ориентированы на изучение слов с учетом их местного контекста использования, где контекст определяется окном соседних слов.Это окно является настраиваемым параметром модели.

Размер скользящего окна сильно влияет на сходство результирующих векторов. Большие окна имеют тенденцию производить больше тематических сходств […], в то время как меньшие окна имеют тенденцию производить больше функциональных и синтаксических сходств.

— стр. 128, Методы нейронных сетей в обработке естественного языка, 2017.

Ключевым преимуществом этого подхода является то, что высококачественные вложения слов могут быть эффективно изучены (низкая пространственная и временная сложность), что позволяет изучать более крупные вложения (больше измерений) из гораздо больших массивов текста (миллиарды слов).

3. перчатка

Алгоритм глобальных векторов для представления слов, или GloVe, является расширением метода word2vec для эффективного изучения векторов слов, разработанного Пеннингтоном и др. в Стэнфорде.